Lokális AI futtatás 2026 – Qwen 3.6, NVIDIA DGX Spark és a szuverén AI infrastruktúra

Miért robbant be a lokális AI 2026-ban?

Két év alatt megfordult a piac. 2024-ben még szinte minden vállalati AI projekt OpenAI vagy Anthropic API-ra épült. 2026 áprilisában a Premai felmérése szerint a termelésben AI-t használó cégek 68%-a hibrid modellben dolgozik - kombinálja a felhő API-kat egy lokálisan futtatott, nyílt súlyú modellel.

Három dolog változott meg radikálisan:

- Az open-source modellek utolérték a frontiert. A Qwen3.5-9B benchmarkjai megelőzik az OpenAI GPT-OSS-120B-jét MMLU-Pro-n (82.5 vs 80.8) - egy nagyságrenddel kisebb modell.

- Az EU AI Act 2026. augusztus 2-án élesedik. A magas kockázatú rendszerek esetében bírság 35 millió euróig vagy a globális árbevétel 7%-áig mehet - és sok cég számára a lokális futtatás a legegyszerűbb compliance-stratégia.

- Az NVIDIA piacra dobta a DGX Spark-ot. Először létezik 4-5000 dolláros áron asztali “AI szuperszámítógép”, ami 70B paraméteres modellt képes finomhangolni helyben.

Ez a cikk gyakorlati útmutató: pontos benchmarkok, tényleges árak, és mikor éri meg lokálisra váltani.

Mi az a “lokális AI futtatás”?

Lokális AI alatt azt értjük, amikor a nyelvi modell a saját infrastruktúrádon fut - nem küldsz adatot OpenAI vagy Anthropic szerverére. Három fő topológia létezik:

| Topológia | Hol fut | Tipikus eset |

|---|---|---|

| On-premise | Saját szerverteremben / irodában | Egészségügy, jog, banki adatok |

| Private cloud | Dedikált felhő instanszokon (AWS, Azure, GCP) | EU-ban szigorúan adatkezelő cégek |

| Edge / desktop | Egy fejlesztő gépén / DGX Spark / Mac Studio | Prototípus, kis csapat, R&D |

A különbség: mindenhol te vagy az adat gazdája, és te dönted el, milyen modell milyen prompttal milyen logokkal fut.

Qwen 3.6 - friss release (2026. április)

Az Alibaba 2026. április 20-án dobta piacra a Qwen3.6-Max-Preview-t, majd április 22-én a Qwen3.6-27B nyílt súlyú variánst. Ez a Qwen-család harmadik major release-e idén - a tempó jelzi, milyen versenyhelyzetben van a kínai open-source AI-fejlesztés.

Mit hoz a Qwen 3.6 a Qwen 3.5-hez képest?

- 260,000 token kontextus ablak (vs Qwen 3.5 128k) - egész kódbázist beletehetsz egy promptba

preserve_thinkingfunkció - agentikus workflow-ban a model “gondolkodás-tokenjei” megmaradnak körök között, így a tool-call láncok jobbak- Agentikus kódolás: SkillsBench +9.9 pont, SciCode +10.8 pont, Terminal-Bench 2.0 +3.8 pont a 3.5-höz képest

- 6 #1 helyezés vezető kódbenchmarkokon (SWE-bench Pro, SciCode, SkillsBench között)

A Qwen3.6-27B nyílt súlyú verziót már lehet on-prem futtatni. A Qwen3.6-Max-Preview egyelőre csak Alibaba Cloud Model Studio API-n érhető el (qwen3.6-max-preview modell-azonosító, OpenAI-kompatibilis endpoint).

Forrás: Qwen 3.6 Max Preview hivatalos blog, QwenLM/Qwen3.6 GitHub

Qwen 3.5 és 3.6 - az open-source forradalom

A kínai Alibaba Qwen modellcsaládja 2026-ra a nyílt súlyú LLM-ek de facto sztenderdjévé vált európai vállalati környezetben - főleg az Apache 2.0 licenc miatt (üzletileg szabadon használható, ellentétben pl. a Llama-val).

Qwen 3.5 / 3.6 benchmark számok (2026 Q1-Q2)

| Modell | MMLU-Pro | HumanEval (kód) | RAM | Sebesség (RTX 4090) |

|---|---|---|---|---|

| Qwen3.5-4B | 64.1 | 71.3 | 8 GB | ~120 token/s |

| Qwen3.5-9B | 82.5 | 78.4 | 16 GB | ~85 token/s |

| Qwen3.5-27B | 71.2 | 85.1 | 24 GB | 55 token/s |

| Qwen3-30B-A3B (MoE) | 79.8 | 82.0 | 20 GB | ~70 token/s |

| Qwen3-32B-Coder | 73.9 | 88.0 | 32 GB | ~45 token/s |

| Qwen3.6-27B (új) | 73.5 | 86.4 | 24 GB | ~50 token/s |

Forrás: Qwen Team Technical Report, Local AI Master 2026 benchmarks

Mit jelent ez a gyakorlatban?

- Qwen3.5-9B: a “sweet spot” a legtöbb KKV-nak. Egy 24 GB-os RTX 4090 vagy egy M3 Pro Mac elfut - és erősebb, mint a GPT-OSS-120B általános tudásban.

- Qwen3-32B-Coder: ha kódgenerálásra kell, 88% HumanEval - több, mint a DeepSeek V3.2 Speciale (82.6%), ami 8 H100-at igényel.

- Qwen3-30B-A3B (Mixture of Experts): csak 3B aktív paraméter - gyors válaszidő, de 30B tudás-kapacitás. AIME 2024 matek benchmarkon 73-87% pass accuracy.

A Qwen alkalmazási esetek, amelyeket nálunk az ügyfelek leggyakrabban kérnek

- Belső dokumentum-asszisztens (RAG over policy + HR + technikai docs)

- Ügyfélszolgálati chatbot ahol az adatkivitel nem opció (pl. egészségügy)

- Kódkiegészítő ahol a forráskód belső, nem mehet ki Cursor / Copilot felé

- Számla / dokumentum kivonatolás GDPR-érzékeny adatokkal

NVIDIA DGX Spark - az asztali AI szuperszámítógép

Az NVIDIA 2025 végén dobta piacra a DGX Spark-ot, és 2026 februárjában 3,999 dollárról 4,699 dollárra emelte az árát (memóriaellátási szűk keresztmetszet miatt - NVIDIA hivatalos közlemény).

A specifikációk

- GB10 Grace Blackwell Superchip: 5. generációs Tensor Core, FP4 támogatás

- CPU: 20 magos Arm (10× Cortex-X925 + 10× Cortex-A725)

- Egységes memória: 128 GB LPDDR5x @ 8,533 MT/s

- Memória sávszélesség: 273 GB/s

- AI teljesítmény: 1 petaFLOP FP4-en

- Maximális modellméret: 70B finomhangolásra, 200B inferenciára

Tényleges DGX Spark benchmarkok (GPT-OSS 120B, 128k kontextus)

| Hardver | Prefill (tok/s) | Decode (tok/s) |

|---|---|---|

| DGX Spark (NVFP4) | 1,723.1 | 38.55 |

| AMD Strix Halo (MXFP4) | 339.9 | 34.13 |

| 3× RTX 3090 (MXFP4) | 1,641.9 | 124.03 |

Forrás: IntuitionLabs DGX Spark Review

Kritikus megfigyelés: a DGX Spark prompt-feldolgozásban (prefill) az élmezőnyben van, de generálásban (decode) lassabb, mint egy 3 darab használt RTX 3090-es rig (~3500-4500 dollár). Az ok: az LPDDR5x memória 273 GB/s sávszélessége korlátoz, míg egy RTX 3090 936 GB/s-t tud.

A CES 2026-os szoftverfrissítés (TensorRT-LLM optimalizációk + spekulatív dekódolás) 2.5×-es teljesítményjavulást hozott a launch-hoz képest, videogenerálás 8×-os javulást.

Mikor éri meg a DGX Spark?

Igen:

- Ha prototípus-fejlesztés a fő use case (sok modell tesztelése, fine-tuning)

- Ha az NVIDIA stack (CUDA, TensorRT, NIM) integráció előny

- Ha kompakt, asztali eszköz kell (irodában 1U mini PC-méret)

- Ha EU AI Act compliance miatt nem mehet az adat felhőbe

Nem:

- Ha sok concurrent felhasználó kell (production inferencia → inkább több RTX 4090 / RTX 5090)

- Ha csak inference, nincs fine-tuning → 2× RTX 4090 olcsóbb és gyorsabb

- Ha költségérzékeny vagy és nem érdekel az NVIDIA ökoszisztéma

Alternatívák ugyanabban a kategóriában

| Eszköz | Egyesített memória | Sávszélesség | Ár (2026 Q2) |

|---|---|---|---|

| NVIDIA DGX Spark | 128 GB | 273 GB/s | $4,699 |

| Apple Mac Studio M4 Ultra | 192–512 GB | >800 GB/s | $5,999–$11,999 |

| AMD Strix Halo (Ryzen AI Max+ 395) | 128 GB | 256 GB/s | ~$2,500 |

| 2× RTX 5090 build | 64 GB GDDR7 | 1,792 GB/s | ~$5,500 |

Forrás: Tom’s Hardware DGX Spark Review

A Mac Studio M4 Ultra nyers memória-sávszélességben veri a Spark-ot, és nagyobb modelleket is elfut (egészen 405B paraméterig 512 GB-os konfigurációval). A hátrány: nincs CUDA, ezért sok ML eszköz csak korlátozottan működik.

Hibrid stratégia: mikor lokális, mikor felhő?

A 2026-os legjobb gyakorlat nem “minden lokális” - hanem a megfelelő modellt a megfelelő feladathoz.

Mikor lokális Qwen / Llama / DeepSeek?

- Nagy volumen, ismétlődő feladat (pl. dokumentum-osztályozás napi 50,000 doksin)

- Érzékeny adat (PII, egészségügyi, jogi, pénzügyi)

- Determinisztikus válasz kell (azonos input → azonos output, fix model verzió)

- Latency-kritikus (saját LAN-on 5-20ms vs felhő 200-500ms)

Mikor felhő API (OpenAI / Anthropic / Google)?

- Frontier képesség kell (Claude Opus, GPT-5 szintű komplex reasoning)

- Burst használat (havi pár ezer token, idle GPU-t pazarolnál)

- Multi-modal (videó-megértés, képgeneráció - itt még messze a frontier)

- Hatalmas kontextus (1M+ token egyetlen hívásban)

A megtérülési pont - friss 2026-os adatok

A Premai 2026 Q1 elemzése szerint:

- 5 millió token / nap átlagosan: 18-24 hónap alatt térül meg az on-prem

- 10 millió token / nap felett: 12-18 hónap alatt

- 70B modellre éles environment felépítése: $40,000–$190,000 kezdő befektetés

- Rejtett költségek: +40-60% (üzemeltetés, áram, frissítés)

- 3 éves megtakarítás: akár 50% a felhő API-hoz képest, ha kihasznált a kapacitás

Forrás: Premai On-Premise LLM Deployment, SitePoint TCO Analysis 2026

Magyar KKV-kontextus

Egy középvállalati ügyfelünk 2026 januárjában váltott át OpenAI API-ról Qwen3.5-9B + RTX 4090 setup-ra:

- Korábban: 1,800 EUR/hónap OpenAI API (átlag 8M token/nap)

- Most: 4,200 EUR egyszeri hardver + ~120 EUR/hó áram + üzemeltetés

- Megtérülés: 4. hónap végén

- Compliance: kórház-partnerük megnyugodott, hogy a páciens-adatok el sem hagyják az országot

Implementációs stack 2026-ban

Inferencia szerver

- vLLM 0.7+ - a de facto sztenderd OpenAI-kompatibilis API-val

- TensorRT-LLM - ha NVIDIA, ha maximális sebesség kell

- Ollama 0.19+ - fejlesztői gépre, M-széria Mac-en MLX-szel majdnem 2× sebesség

- llama.cpp - CPU-only, vagy GGUF kvantált modellek

DGX Spark + vLLM gyorsindító - spark-vllm-docker

A DGX Spark-ra a legrosszabb élmény az lenne, ha 2-3 napig konfigurálnád a vLLM-et CUDA 12.1a architektúrára. Szerencsére van egy közösségi projekt, eugr/spark-vllm-docker, ami kifejezetten DGX Spark-ra (NVIDIA GB10, sm_121a) készült.

Mit ad:

- Előre buildelt vLLM wheel-ek GitHub Releases-ből, naponta tesztelve - nem kell forrásból fordítani

- Multi-node Ray cluster - kettő vagy három DGX Spark-ot összeköthetsz InfiniBand / RoCE-on át

- Modell-receptek előre konfigurálva: Qwen 3.5-397B (igen, 397B paraméter három Spark-on!), Qwen3-Coder-Next, MiniMax M2/M2.5, GLM-4.7, Nemotron, GPT-OSS-120B

- Kvantálás-támogatás: AWQ, INT4-AutoRound, NVFP4, FP8

- FastSafeTensors - gyorsabb modell-betöltés

- Non-privileged container - biztonságos prod-deployment

Indítás solo (egy Spark) módban:

git clone https://github.com/eugr/spark-vllm-docker.git

cd spark-vllm-docker

./build-and-copy.sh

./launch-cluster.sh --soloEgy két-Sparkos clusterhez -c flag és launch-cluster.sh multi-node opciók.

Megjegyzés: a Qwen 3.6-27B még nincs a hivatalos receptben (frissek a release-ek), de a 3.5 receptből pár sor módosítással működésre lehet bírni.

Modell-menedzsment és RAG

- Qdrant vagy Weaviate - vektor DB

- LangChain vagy LlamaIndex - RAG keretrendszer

- Langfuse (self-hosted!) - observability, prompt tracking (részletes összehasonlítás Langsmith-tel)

Biztonsági réteg

- Garak vagy Promptfoo - prompt injection tesztelés

- NeMo Guardrails - output szűrés

- Llama Guard 3 - content moderation lokálisan

A leggyakoribb buktatók - amit nem írnak a marketinganyagokba

1. Memória ≠ teljesítmény

A 128 GB unified memóriás Spark lassabb generálásban, mint egy 24 GB-os RTX 4090 - egy 9B modell esetén. A nagy modell csak akkor előny, ha tényleg kell a kapacitás.

2. A kvantálás minőség-tax-ot ad

Egy Q4 kvantált 70B modell 8-12% MMLU pontot veszít Q8-hoz képest. Sok publikált benchmark Q8/FP16 - éles környezetben Q4-Q5-öt fogsz használni.

3. A hosszú kontextus drága

A 128k context window memória-igénye négyzetesen nő. Egy 32B modell 128k kontextus-szal 60-80 GB VRAM-ot igényel csak az attention cache-re.

4. A finomhangolás (LoRA) nem ezüstgolyó

LoRA fine-tuning nem fogja a tudást a modellbe írni. RAG-ot helyettesít - nem. Ha céges dokumentumokra akarsz válaszolni, RAG-ot építs, ne LoRA-t.

5. A támogatási teher valós

Egy on-prem AI rendszer napi felügyeletet igényel: GPU monitoring, modell-frissítések, biztonsági patch-ek. Ha nincs DevOps kapacitás, a felhő olcsóbb lesz hosszú távon is.

Mit ajánlunk magyar KKV-knak - döntési mátrix

| Vállalat mérete | Use case | Ajánlott stack |

|---|---|---|

| 1-10 fő | Kísérletezés, prototípus | Ollama + Qwen3.5-9B M3/M4 Mac-en |

| 10-50 fő | Belső chatbot, RAG | RTX 4090 + vLLM + Qwen3.5-27B |

| 50-200 fő | Production AI 100+ user | DGX Spark vagy 2× RTX 5090 + vLLM |

| 200+ fő | Enterprise + compliance | Több GPU node + Kubernetes + privát Qwen / Llama |

Az első lépések

Ha most kezdesz lokális AI-val, ne vegyél azonnal hardvert. Az 5 lépéses workflow:

- Definiálj egy konkrét use case-t (pl. “számlák kivonatolása német VAT-tal”)

- Mérd fel a token-volument (mennyi/nap?)

- Tesztelj felhőben először (1-2 hét OpenAI / Anthropic API → tudd, működik-e a koncepció)

- Próbálj nyílt modellt felhőben (Together.ai, Fireworks, Groq → ugyanaz a Qwen / Llama, csak nem a saját géped)

- Csak ezután váltás lokálisra, ha a token-volumen igazolja

A legtöbb cég már a 3. lépés után látja, hogy a felhő-OpenAI költség 3x-osa a Together.ai-on futó Qwen3.5-9B-nek - anélkül, hogy egy szervert is venni kéne.

Kérj ingyenes AI infrastruktúra konzultációt

Ha érdekel, hogy a te céged AI igényei lokálisan vagy felhőben térülnek meg jobban, 30 perces ingyenes konzultáción átnézzük:

- Aktuális AI költségeid

- Adatérzékenység és compliance követelmények

- Várható növekedés

- Ajánlott modell + hardver stack

- Várható ROI hónapokban

Kérj ingyenes konzultációt - vagy nézd meg az ingyenes SEO + AI auditunkat, ami a digitális stratégiád átfogó értékelése.

Kapcsolódó cikkek

- AI integráció meglévő rendszerekbe - technikai megközelítés

- RAG rendszerek: intelligens tudásbázis - RAG mélyfúrás

- AI integráció a valóságban - esettanulmányok - 7 valós ROI eset

- Langfuse vs Langsmith - AI observability self-hosted

Forrásjegyzék

- Qwen3 Technical Report (arxiv)

- NVIDIA DGX Spark hivatalos termékoldal

- IntuitionLabs DGX Spark Benchmarks

- Tom’s Hardware DGX Spark Review

- Premai On-Premise LLM Cost Analysis

- SitePoint Local LLMs vs Cloud TCO 2026

- Spheron - DeepSeek V3.2 vs Llama 4 vs Qwen 3

Képgenerálási promptok (Midjourney / Flux / DALL-E)

Ezeket a promptokat használd az illusztrációk legenerálásához. A cikk megjelenítésénél ezt a szakaszt érdemes eltávolítani.

Hero kép (heroImage csere)

Cinematic dark studio shot of a sleek black NVIDIA DGX Spark mini-AI-supercomputer on a polished concrete desk, glowing lime-green LED accent strip, scattered server cooling fins reflection, dim purple rim light, ultra-detailed product photography, 8k, dramatic shadows, AppForge brand palette (deep black #0a0a0a, lime accent), 16:9 aspect ratio, no textIn-content kép 1 - “Qwen 3.5 benchmark vizualizáció”

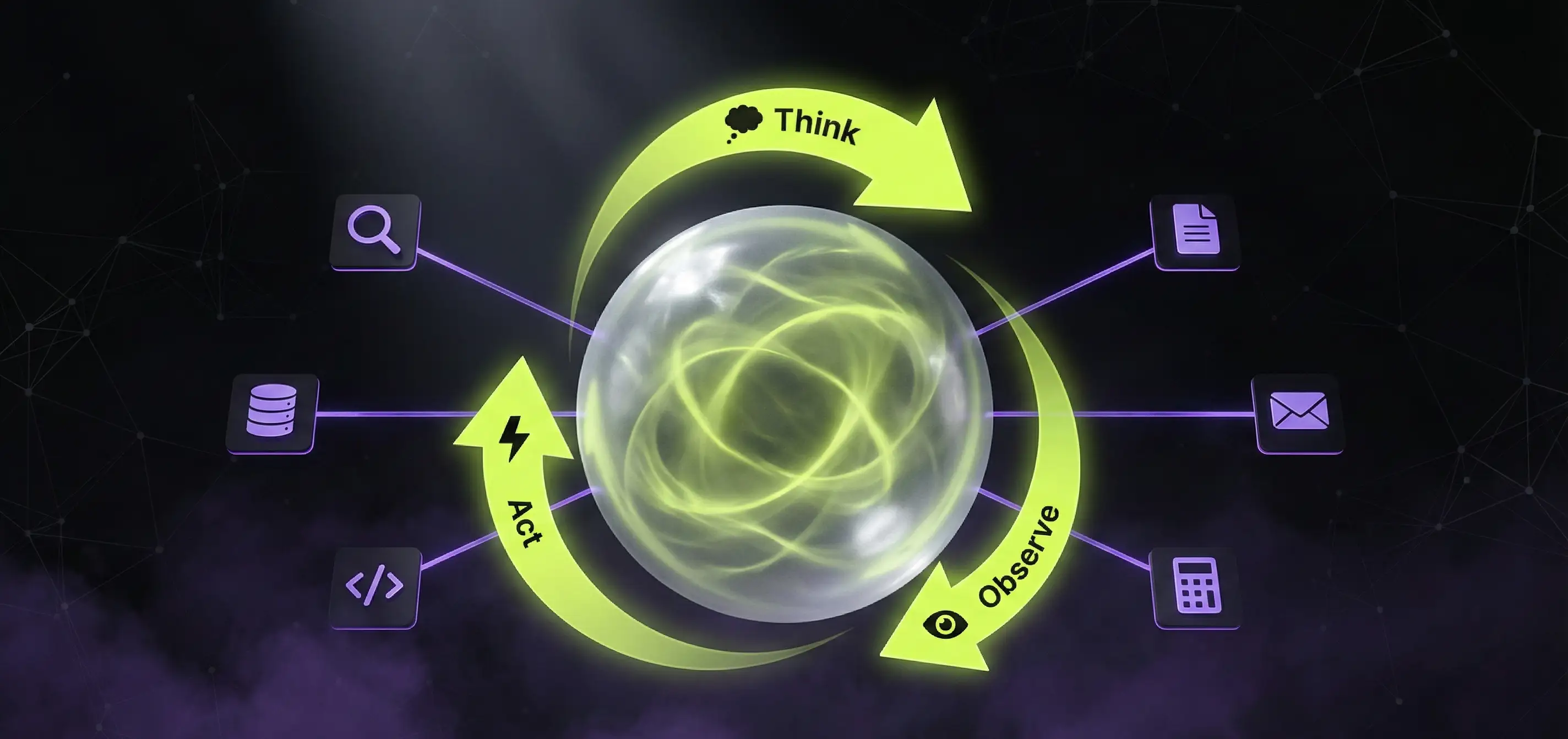

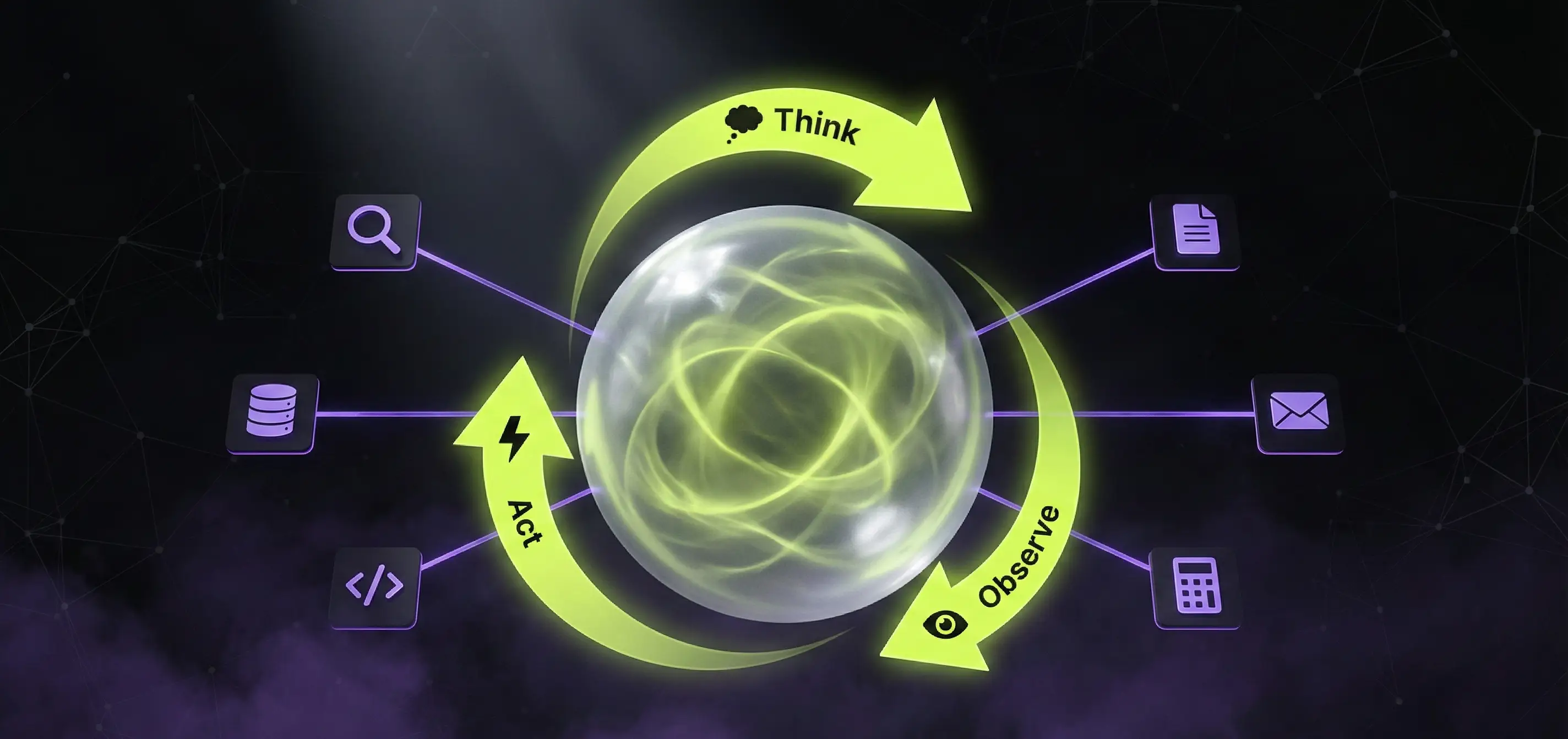

Minimalist data visualization, dark background, glowing lime-green and purple bar chart comparing Qwen3.5-9B (82.5 MMLU-Pro) towering over GPT-OSS-120B (80.8) and Llama 3.3 (78.4), futuristic UI style, thin sans-serif labels, subtle grid, 16:9, AppForge dark themeIn-content kép 2 - “Lokális vs felhő architektúra diagram”

Isometric technical diagram on dark background, on-premise GPU server (left side, lime-green glow) connected to office workstations, vs floating cloud icon (right side, purple glow) with API arrows, clean line-art style, AppForge color palette, 16:9, infographic-style with minimal text labelsIn-content kép 3 - “DGX Spark alkalmazási környezet”

Modern Hungarian SMB office, developer reviewing terminal output on a 4K monitor, NVIDIA DGX Spark visible on desk emitting subtle lime LED glow, soft warm window light from left, slight cyberpunk aesthetic, photorealistic, 3:2 aspect ratioMI-megoldásra van szükséged?

Automatizáld a munkafolyamataidat és szerezz versenyelőnyt mesterséges intelligencia megoldásainkkal.

Kapcsolódó cikkek

Ezek a cikkek is érdekelhetnek

AI chatbot vs n8n vs egyedi AI ügynök 2026 – Mikor melyik?

AI chatbot, n8n workflow vagy egyedi AI ügynök - melyik passzol a vállalkozásodhoz? Gyakorlati 2026-os összehasonlítás árakkal, példákkal és döntési mátrixszal.

ChatGPT magyar nyelven vállalati használatra 2026 – Útmutató cégeknek

ChatGPT magyar vállalati használat 2026: hogyan integráld a ChatGPT-t (és más LLM-eket) a céges folyamataidba. Árak, GDPR, EU AI Act, magyar nyelvi minőség, gyakorlati példák.

Egyedi weboldal készítés vs sablon 2026 – Őszinte összehasonlítás magyar cégeknek

Egyedi weboldal készítés vagy sablon 2026-ban? Számokra épülő, őszinte összehasonlítás: árak, SEO, sebesség, hosszú távú költségek és üzleti megtérülés magyar cégeknek.