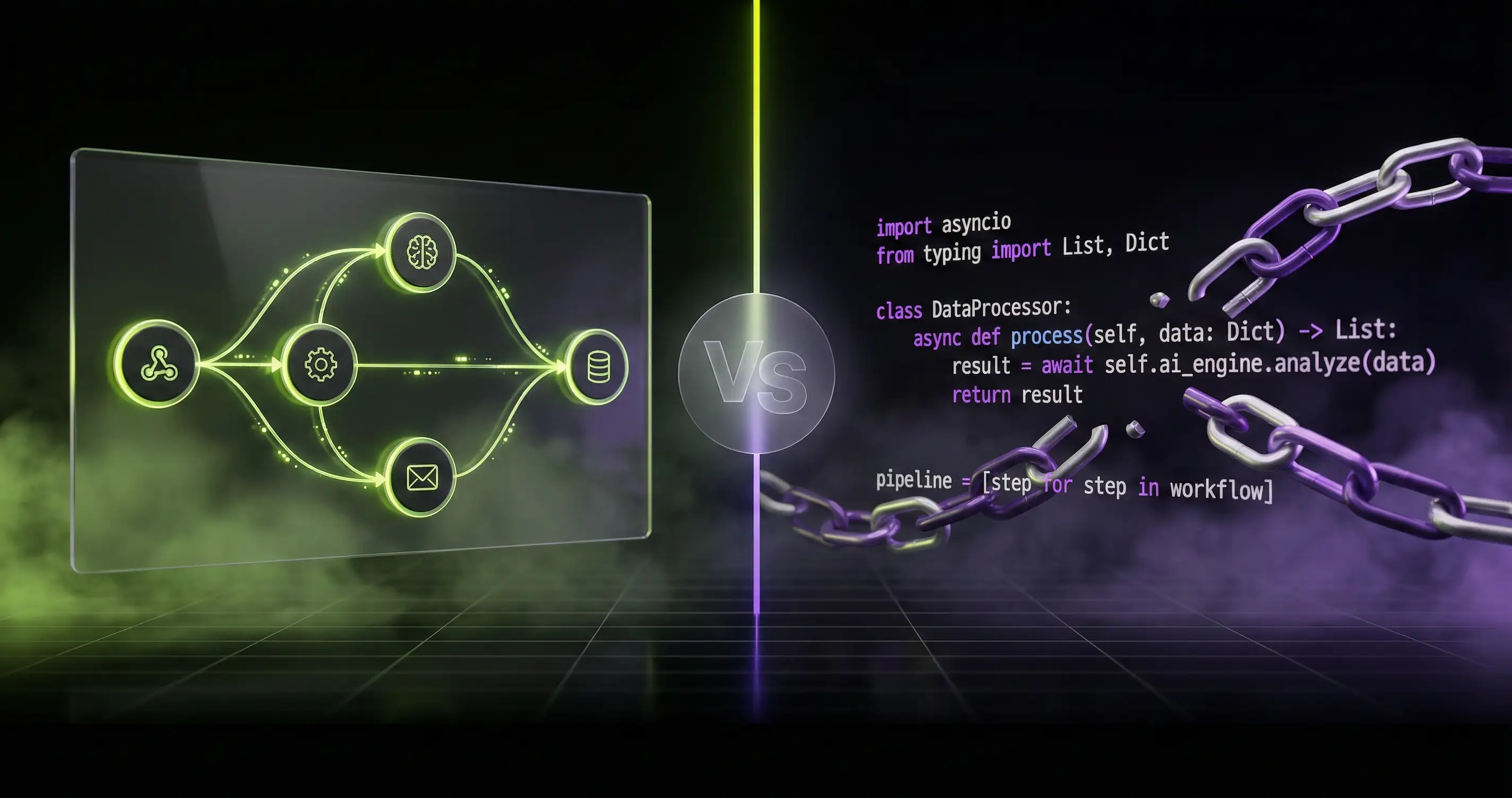

n8n vs LangChain: Melyiket válaszd AI workflow automatizáláshoz?

Két eszköz, két filozófia

Ha AI-alapú automatizálást tervezel, előbb-utóbb szembe fogsz találni ezzel a kérdéssel: n8n vagy LangChain? A válasz nem olyan egyszerű, mint gondolnád - mert ez két alapvetően különböző eszköz, amelyek különböző problémákat oldanak meg. Mégis egyre gyakrabban vetik össze őket, mert mindkettő az AI workflow-ok világában mozog.

Ebben a cikkben végigmegyünk a lényeges különbségeken, konkrét use case-eken, és segítünk eldönteni, hogy a te projektedhez melyik (vagy mindkettő) illik.

Mi az n8n?

Az n8n (ejtsd: “n-eight-n”) egy nyílt forráskódú, vizuális workflow automatizáló platform. Gondolj rá úgy, mint egy self-hosted Zapier, ami sokkal többet tud. A lényege: drag-and-drop felületen összekötsz szolgáltatásokat, API-kat, adatbázisokat - és az egész vizuálisan követhető.

Az n8n erősségei

- 400+ beépített integráció: Slack, Gmail, Google Sheets, Notion, PostgreSQL, HTTP request - szinte bármit összeköthetesz

- Vizuális editor: Nem kell kódolnod ahhoz, hogy komplex workflow-okat építs

- Self-hosting: Futtathatod a saját szervereden, teljes kontrollal az adataid felett

- AI node-ok: Az n8n 1.x komolyan bővítette az AI képességeit - beépített LLM node-ok, AI agent node-ok (sub-agent támogatással), vektor store integráció, és MCP (Model Context Protocol) kompatibilitás

- Code node: Ha a vizuális node-ok nem elégek, JavaScript vagy Python kóddal bővítheted

n8n árazás (2026)

Az n8n cloud verzió $20/hó-tól indul (2500 execution/hó), a Pro terv $50/hó (10 000 execution). A self-hosted verzió szoftverként ingyenes, de a valós infrastruktúra költség $50-300/hó között mozog a mérettől függően. 2025-ben az n8n átállt execution-alapú számlázásra, és 2026-ra ez vált az iparági standarddá - korlátlan workflow, de az egyes futtatások számítanak.

Mi a LangChain?

A LangChain egy Python (és JavaScript/TypeScript) framework, amelyet kifejezetten LLM-alapú alkalmazások fejlesztésére terveztek. Nem egy no-code eszköz - ez fejlesztőknek szóló könyvtár, amivel összetett AI pipeline-okat, agent-eket és RAG rendszereket építhetsz.

A LangChain erősségei

- Mély LLM integráció: Natív támogatás az összes nagyobb modellhez (GPT-5.2, Claude Opus 4.6, Gemini 3 Pro, Mistral Large 2, Llama 4, Ollama)

- LCEL (LangChain Expression Language): Deklaratív pipeline építés, ahol a komponenseket láncokba fűzöd

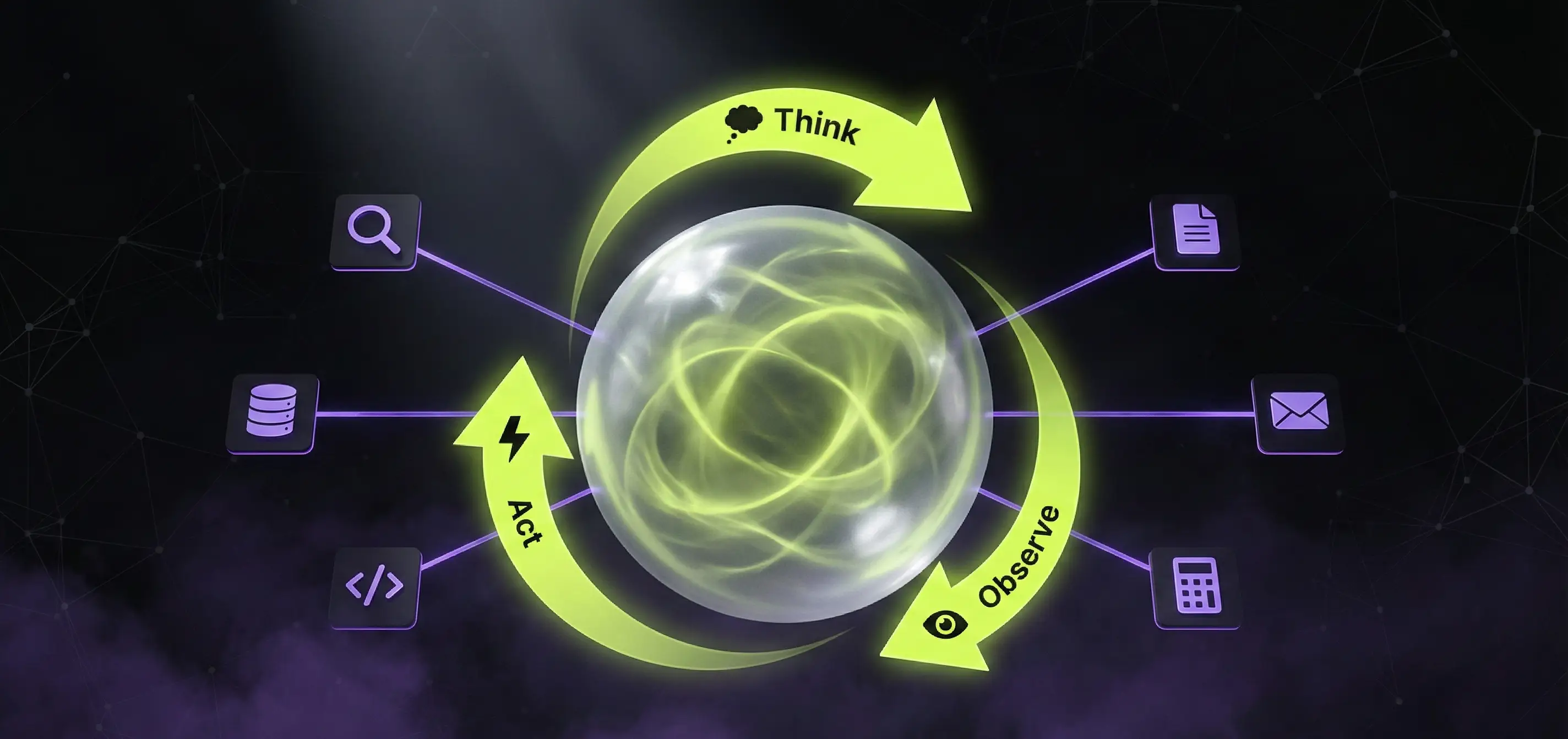

- Agent framework: ReAct pattern, tool use, custom agent-ek - a LangChain volt az első komolyabb agent framework

- Ökoszisztéma: LangSmith (monitoring), LangGraph (komplex agent orkesztráció), LangServe (deployment)

- Közösség: Hatalmas community, rengeteg tutorial, és folyamatos fejlesztés

LangChain ökoszisztéma (2026)

A LangChain v0.3+ 2026-ra jelentősen fejlődött. A LangGraph megjelenésével a keretrendszer két részre vált:

- LangChain: Alap komponensek és egyszerű chain-ek (RAG, összegzés, egyszerű chatbot-ok)

- LangGraph: Komplex, állapotkezelő, ciklikus agent workflow-ok gráf-alapú architektúrával

Architektúra: a lényegi különbség

Itt válik ketté igazán a két eszköz:

n8n: Vizuális DAG

Az n8n workflow-ok irányított aciklikus gráfok (DAG): a folyamat egyirányú, nincs benne loop. Minden node egy-egy lépés (API hívás, adattranszformáció, feltétel), és a flow vizuálisan követhető. Az AI node-ok ebben a rendszerben “csak” további node-ok - beilleszted az LLM-et a workflow-ba, mint bármely más szolgáltatást.

[Trigger] → [Adat lekérés] → [LLM feldolgozás] → [Válasz küldés]LangChain/LangGraph: Programozott gráf

A LangChain LCEL pipeline-jai szintén lineárisak (DAG), de a LangGraph ciklikus gráfokat is kezel - az agent visszatérhet korábbi lépésekhez, döntési pontokat hozhat létre, és állapotot tart fenn lépések között.

from langgraph.graph import StateGraph

graph = StateGraph(AgentState)

graph.add_node("reason", reasoning_step)

graph.add_node("act", tool_execution)

graph.add_node("evaluate", evaluation_step)

graph.add_edge("reason", "act")

graph.add_edge("act", "evaluate")

graph.add_conditional_edges("evaluate", should_continue, {

True: "reason", # Vissza a gondolkodáshoz

False: END

})Ez a különbség kritikus: ha az AI agent-ednek iterálnia kell (pl. többször próbálkozik, kiértékeli a saját válaszát, döntés alapján más útvonalat választ), a LangGraph lényegesen rugalmasabb.

Gyakorlati use case-ek

1. Ügyfélszolgálati pipeline

n8n megoldás: Webhook fogadja az emailt → AI node osztályozza (panasz/kérdés/visszajelzés) → feltételes elágazás → automatikus válasz vagy emberi jóváhagyás → Slack értesítés + CRM frissítés.

LangChain megoldás: Python script, ami LLM-mel elemzi a beérkező üzenetet, tool use-al lekérdezi a CRM-et, multi-step reasoning-gel meghatározza a legjobb választ, és API-n keresztül küldi el.

Verdikt: Ha az ügyfélszolgálat egy nagyobb üzleti workflow része (CRM, Slack, email, spreadsheet integráció), az n8n nyeri. Ha a válaszgenerálás minősége a fő szempont és komplex reasoning kell, a LangChain.

2. Dokumentum feldolgozó rendszer

n8n megoldás: Google Drive trigger → fájl letöltés → szöveg kinyerés → LLM összegzés → eredmény mentése adatbázisba + Slack értesítés.

LangChain megoldás: PDF loader → szöveg chunkolás → embedding generálás → vektor adatbázisba mentés → RAG pipeline a visszakereséshez.

Verdikt: Az n8n jó az egyszerű “feldolgozd és mentsd el” típusú feladatokra. De ha RAG rendszert építesz (vektor keresés, szemantikus visszakeresés, többlépcsős kiértékelés), a LangChain az eszközöd.

3. Adatgazdagítás (data enrichment)

n8n megoldás: Webhook/schedule trigger → adat lekérés API-ból → LLM-mel gazdagítás/osztályozás → eredmény írása spreadsheetbe vagy adatbázisba.

Verdikt: Ez egyértelműen az n8n pályája. Az integrációs ökoszisztéma és a vizuális szerkesztő itt verhetetlenül hatékony - nem kell egyetlen sor kódot sem írnod.

Tanulási görbe

| Szempont | n8n | LangChain |

|---|---|---|

| Célközönség | Business analyst, ops, no-code fejlesztő | Python/JS fejlesztő |

| Belépési küszöb | Alacsony (vizuális editor) | Magas (programozás szükséges) |

| AI funkciók elsajátítása | ~5-10 óra | ~20-40 óra |

| Dokumentáció | Jó, gyakorlati tutorialok | Kiterjedt, de gyorsan változik |

| Debug | Vizuális execution log | Python debugger + LangSmith |

Self-hosting és deployment

n8n

- Docker-rel percek alatt felállítható

- Adatbázis: SQLite (fejlesztéshez) vagy PostgreSQL (produkcióhoz)

- Valós self-hosting költség: $50-300/hó (VPS + adatbázis)

- Cloud verzió: $20-50/hó (managed hosting)

LangChain

- Python package -

pip install langchain - A deployment rajtad múlik: FastAPI wrapper, Docker, serverless (AWS Lambda, GCP Cloud Functions)

- LangServe: egyszerűsített deployment megoldás REST API-ként

- LangSmith: hosted monitoring és tracing (SaaS, külön fizetős)

- Nincs “out-of-the-box” hosting - infrastruktúra know-how szükséges

Alternatívák, amiket érdemes ismerni

A piac 2026-ra jelentősen bővült. Íme a legfontosabb alternatívák:

Flowise

Nyílt forráskódú, vizuális LLM alkalmazás-építő. Az AgentFlow V2 architektúrával a Flowise komoly lépést tett a production felé: node-alapú workflow orkesztráció, MCP integráció, Document Store kezelés és human-in-the-loop támogatás. Ha a LangChain erejét akarod vizuális felülettel, a Flowise jó kompromisszum.

Dify

Szintén nyílt forráskódú LLM alkalmazás platform, de több production-ready funkcióval (tracing, hosting, prompt management). Különösen jó választás, ha nem az OpenAI ökoszisztémában gondolkodsz, mert kiváló támogatást ad az összes LLM szolgáltatóhoz, beleértve a Claude Sonnet 5-öt és a Gemini 3 Pro-t is.

LangGraph

Nem igazán alternatíva, hanem a LangChain evolúciója. Ha komplex, állapotkezelő AI agent-eket építesz, a LangGraph az, amit keresel. 2026-ban már production-grade megoldásként használják - state machine alapú orkesztráció, emberi jóváhagyási pontok, perzisztens memória.

Mikor használd mindkettőt egyszerre?

A legjobb megoldás sokszor az, hogy nem választasz. Egy tipikus architektúra:

- LangChain/LangGraph → Megépíted az AI “agyát”: agent logika, RAG pipeline, komplex reasoning

- FastAPI wrapper → REST API-vá teszed

- n8n → Meghívod az API-t a workflow-ból, és integálod az üzleti rendszerekbe

Így az n8n kezeli az integrációkat (email, CRM, Slack, webhookok), a LangChain pedig a nehéz AI munkát. Ez nem kompromisszum - ez a legjobb mindkét világból.

[n8n Webhook] → [n8n: Adat előkészítés] → [HTTP Request: LangChain API]

↓

[n8n: Eredmény feldolgozás] ← [LangChain: AI reasoning + tool use]

↓

[n8n: Slack + CRM + Email]Összegzés: melyiket válaszd?

Válaszd az n8n-t, ha:

- Üzleti folyamatokat automatizálsz, amelyekbe AI-t illesztenél be

- Sok külső integrációra van szükséged (CRM, email, Slack, adatbázis)

- A csapatodban nem csak fejlesztők dolgoznak

- Gyorsan akarsz eredményt, vizuális felületen

Válaszd a LangChain-t, ha:

- Dedikált AI alkalmazást építesz (chatbot, RAG, agent)

- Teljes kontrollra van szükséged az LLM pipeline felett

- Komplex reasoning, tool use, vagy multi-agent rendszert tervezel

- Van Python/JS fejlesztői kapacitásod

Válaszd mindkettőt, ha:

- Enterprise szintű rendszert építesz, ahol az AI csak egy komponens

- Az AI logikát izolálni akarod az üzleti workflow-któl

- Skálázhatóságra és karbantarthatóságra is figyelsz

A lényeg: nem az eszköz a fontos, hanem a probléma, amit megoldasz. Az n8n és a LangChain nem versenytársak - kiegészítik egymást. A kérdés nem az, hogy “melyik a jobb”, hanem az, hogy “melyik oldja meg jobban az én konkrét problémámat”.

Ha AI automatizálás tervezéséhez vagy megvalósításához segítségre van szükséged, az AppForge csapata mindkét eszközben otthonosan mozog - és segít megtalálni a projektedhez legjobban illő architektúrát.

MI-megoldásra van szükséged?

Automatizáld a munkafolyamataidat és szerezz versenyelőnyt mesterséges intelligencia megoldásainkkal.

Kapcsolódó cikkek

Ezek a cikkek is érdekelhetnek

AI chatbot vs n8n vs egyedi AI ügynök 2026 – Mikor melyik?

AI chatbot, n8n workflow vagy egyedi AI ügynök - melyik passzol a vállalkozásodhoz? Gyakorlati 2026-os összehasonlítás árakkal, példákkal és döntési mátrixszal.

MI fejlesztés árak 2026 – Mennyibe kerül egy AI megoldás Magyarországon?

Részletes útmutató a mesterséges intelligencia fejlesztés árakról Magyarországon: chatbotok, RAG rendszerek, egyedi modellek és folyamatautomatizálás költségei.

Vállalkozás automatizálás MI-vel: Gyakorlati útmutató KKV-knak

Lépésről lépésre útmutató, hogyan automatizáld az üzleti folyamataidat mesterséges intelligenciával - konkrét eszközökkel és ROI számokkal.